Nutzung von Künstlicher Intelligenz (KI)

KI und Sprachdienstleistungen

Heutzutage ist es fast unmöglich, sich dem ganzen KI-Hype zu entziehen. Das Label „künstliche Intelligenz“ wird einfach wahllos an alles drangepappt. Sogar der Verkehrsbericht meines lokalen Radiosenders soll nun angeblich dank „KI“ besser sein. (Von wegen: Er ist immer noch nicht zuverlässig und weiterhin auf Menschen angewiesen, die dem Sender Staus und Verzögerungen melden.)

Leider haben sich viele Sprachdienstleister voll dem Hype verschrieben, und zwar nicht nur große Agenturen, sondern auch Freiberufler. Es wimmelt von unrealistischen Versprechungen. Ständig heißt es: „KI ist jetzt da und wer das nicht akzeptiert, der bleibt auf der Strecke.“ Doch das ist ein schon oft dagewesener Irrtum. Tatsächlich ruiniert KI-Müll immer mehr das Internet und auch die Qualität von Übersetzungen wird schlechter.

Dazu möchte ich nicht beitragen, denn Sie haben Besseres verdient. Diese Seite erläutert die genaue Problematik und erklärt, wie ich „KI“ nutze und wie nicht. Bei weiteren Fragen nutzen Sie gern mein Kontaktformular.

Die Kurzfassung: Ich habe nichts gegen moderne Technik, aber ich verwende keine „generative KI“ und ähnliche Systeme, bei denen die Vertraulichkeit Ihrer Inhalte und die Qualität meiner Arbeit gefährdet sind.

Was ist „künstliche Intelligenz“?

Das ist die 1-Million-Euro-Frage – und sie hat keine klare Antwort. Das liegt daran, dass der Begriff „künstliche Intelligenz“ keine präzise Definition hat und auch noch nie hatte. Er wurde im Jahr 1956, inmitten des Kalten Krieges, für ein Treffen am Dartmouth College von Forschern geprägt, die damit nicht nur das Interesse von anderen Wissenschaftlern, sondern auch Finanzmittel von privaten Geldgebern für sich gewinnen wollten. Der Begriff ist also schon Jahrzehnte alt und diente von Anfang an vor allem Marketingzwecken.

Deshalb setze ich den Begriff oft in Anführungszeichen. „KI“ ist nur ein schwammiges Modewort. Wir können uns aber auf eine einfache Definition einigen: „Künstliche Intelligenz“ meint Rechensysteme (Computer, Maschinen, Roboter), die mithilfe von Daten lernen (auf überwachte oder unüberwachte Weise), Aufgaben zu bewältigen, die normalerweise menschliche Intelligenz erfordern (in Form von Schlussfolgerung, Verallgemeinerung und Entscheidungsfindung).

Inzwischen werden verschiedene Methoden und Ansätze oft einfach unter diesem „KI“-Begriff zusammengefasst – von Klassifikationsalgorithmen und Clusteranalysen über die maschinelle Sprach- und Bilderkennung bis hin zu komplexen neuronalen Netzen und Deep Learning. Manche Anwendungen in der Praxis sind wirklich nützlich und aus unserem Alltag kaum wegzudenken. Dank optischer Zeichenerkennung kann ich Papierdokumente digitalisieren. Spamfilter ersparen mir Frust (auch wenn sie nicht perfekt arbeiten). Sensoren im Auto weisen mich auf Tempolimits hin, die ich vielleicht übersehen habe.

Problemfall: „generative KI“

Die genannten Beispiele erleichtern meine Arbeit oder vermeiden so manche Kosten. Häufig kann man entsprechende Systeme genauso als Hilfsmittel nutzen wie Taschenrechner und Computer. (Hier sind militärische und menschengefährdende Zwecke ausdrücklich nicht gemeint.) Es gibt jedoch eine Art von „KI“, die von Grund auf problematisch ist und in vielen Bereichen verheerende Folgen hat: generative künstliche Intelligenz (GenKI).

Vereinfacht erklärt: Diese Systeme suchen in Unmengen an Trainingsdaten nach Mustern, speichern dann diese Muster in Form von Millionen von Parametern und erzeugen schließlich neue Inhalte basierend auf den Parametern und spezifischen Eingaben mit Anweisungen. Das eigentliche Problem dabei ist nicht der Ansatz an sich (denn er kann durchaus nützlich sein), sondern die Nutzung solcher Systeme auf unverantwortliche Weise und in Szenarien, in denen ein anderer Ansatz – oder gar der Verzicht auf „KI“ – die bessere Vorgehensweise wäre.

Diese Art von Automatisierung ist hauptverantwortlich für den derzeitigen Hype. Doch wieder einmal geht es nicht um irgendwelche edlen Ziele oder echten Fortschritt, sondern nur um Marketing, Gier und Macht, auch wenn die Trickbetrüger in den Chefetagen der großen KI-Firmen das natürlich leugnen.

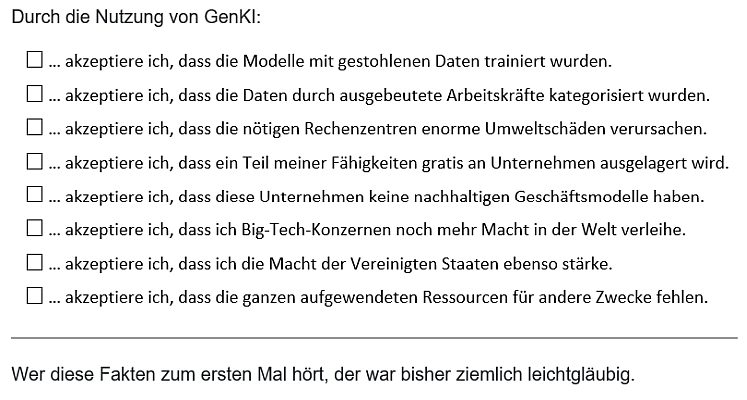

Unterm Strich stehen all den Lügen und Versprechungen bittere Wahrheiten gegenüber: Skrupellose Konzerne wie OpenAI, Anthropic, Midjourney, xAI, Microsoft, Google, Nvidia und noch einige mehr verstoßen systematisch gegen Urheberrechte, entwickeln ihre Systeme durch Ausbeutung unzähliger Datenarbeiter, pumpen rücksichtslos toxische Abgase in zumeist von ärmeren Menschen bewohnte Stadtteile, ignorieren den Willen der örtlichen Wählerschaft, verschärfen die Klimakrise durch den immensen Wasserverbrauch und hohen Energiebedarf ihrer Rechenzentren (durch Greenwashing und manipulative Berichte geschickt von der Öffentlichkeit verborgen), zerstören die Integrität von Informationssystemen und machen uns nur dümmer, während sie Gewalt fördern (einschließlich Schusswaffenmissbrauch, sexualisiertem Missbrauch durch Deepfake-Pornografie und Suizidgefährdung von Jugendlichen) und obendrein Milliardensummen im Kreis untereinander hin und her schieben, bis die gigantische Wirtschaftsblase platzt und alle trifft, nur nicht die Tech-Milliardäre.

Mein Umgang mit „KI“ und „GenKI“

Ich bin kein Fan von unregulierter und schädlicher „generativer KI“. Es gibt bisher keine ethisch vertretbare Nutzung von ChatGPT, Claude, Gemini und ähnlichen Modellen, denn es sind nicht nur einzelne problematische Tools, sondern die gesamte Infrastruktur basiert auf Ausbeutung und Missbrauch.

Solange die Herrschaften im Silicon Valley und Tech-Fanatiker rund um die Welt nach dem Motto „erstmal machen, später um Erlaubnis fragen“ handeln und Aufsichtsbehörden aufgrund von Ignoranz oder Inkompetenz passiv zusehen, sollten Nutzer, Verbraucher und Unternehmen sich genauer informieren und diese destruktiven Systeme ablehnen. Zudem zeigen mehr und mehr Studien, dass die erhofften Produktivitätsgewinne durch „KI“ ausbleiben und stattdessen Angestellte durch KI-Müll überlastet werden.

Ich möchte Ihnen akkurate und qualitativ überzeugende Sprachdienstleistungen zu einem fairen Preis bieten. Dieses Ziel ist inkompatibel mit der Nutzung von GenKI-Systemen, die minderwertige Ausgaben generieren und unnötigen Mehraufwand verursachen.

Für ChatGPT und Co. ist in meinen normalen Arbeitsabläufen kein Platz. Ich habe keine Abos und lade Ihre vertraulichen Daten nicht in diese Systeme hoch.

Das heißt nicht, dass ich eine Technikgegnerin bin oder alle Formen von „künstlicher Intelligenz“ pauschal ablehne. Ich versuche jedoch, meine genutzten Tools bewusster auszuwählen und ihre Auswirkungen auf die Gesellschaft zu beachten. Manchmal gibt es moralische Grauzonen, bei denen ich potenziellen Schaden und Nutzen gegeneinander abwiegen muss. Vor allem aber bekommen Sie von mir keine falschen Versprechungen zu den Fähigkeiten von „KI“.

„KI“-Funktionen von Übersetzungssoftware

Wenn es um spezifische Tools für Sprachdienstleister geht, wird die Sache ein bisschen komplizierter. Wie auf meiner Seite für MTPE-Services erklärt, gibt es seit Langem sogenannte CAT-Software (Computer-Assisted Translation) mit diversen Funktionen, die den Übersetzungsprozess effizienter machen.

Leider sind auch die Unternehmen hinter diesen Tools größtenteils dem „KI“-Wahn verfallen. RWS bewirbt Trados Studio als „die ausgereifteste KI-gestützte Übersetzungsumgebung für Sprachprofis“. Die Konkurrenz bei memoQ geht zwar nicht ganz so offensiv vor, bietet aber ebenfalls „KI-basierte Technologie zur Übersetzungsautomatisierung“. Bei Lokalise gibt es angeblich eine „KI-Lokalisierungsplattform von Weltklasse“, doch das System ist offenbar so schlecht, dass es nicht mal zur Übersetzung der Produktwebsite reicht. Und auch die cloudbasierte Plattform Phrase ist wohl „mit intelligenter KI ausgestattet“, aber die Redundanz in der Formulierung zeigt, was für minderwertige Ergebnisse Sie erwarten dürfen. Seufz.

Trotzdem sind CAT-Tools für mich nützlich. Es wäre irrational, sie aus meinen Abläufen zu verbannen. Funktionen zur Terminologie- und Projektverwaltung helfen mir, schneller zu arbeiten und meine Preise für Sie zu senken. Mein oben beschriebener Ansatz gilt aber auch hier: Ich priorisiere die Qualität und deaktiviere beziehungsweise nutze keine „KI“-Funktionen oder Plug-ins, die Ihre vertraulichen Inhalte an Dritte übertragen.

Apropos Vertraulichkeit: Haben Ihnen andere Anbieter versprochen, „dass wir DeepL in der Aboversion nutzen und deswegen Ihre sensiblen Inhalte nicht mit Dritten geteilt werden“? Dann fragen Sie lieber nochmal nach, denn dieses bisherige Alleinstellungsmerkmal von DeepL ist Geschichte.

Weitere Ressourcen

Viele Links auf dieser Seite führen zu Recherchen, die noch mehr Links zu Studien und weiteren Informationen enthalten. Auch empfehlenswert:

- The AI Con von Emily M. Bender und Alex Hanna ist ein gutes einführendes Buch für Laien und widmet sich den Problemen, falschen Versprechungen und Herausforderungen rund um „künstliche Intelligenz“ und „Big Tech“. (Eine deutsche Übersetzung wird es hoffentlich bald geben.)

- Wenn Sie viel Zeit und Lust auf richtig tiefgehende Bücher haben, finden Sie in der von Prof. Dagmar Monett zusammengestellten Liste mit empfohlenen Büchern, die sich kritisch mit KI auseinandersetzen, bestimmt genug Lesestoff.

- Mögen Sie lieber Audio/Video? Dann schauen Sie sich das Interview mit Karen Hao zu kultartigen KI-Unternehmen an und abonnieren Sie den Podcast Tech Won’t Save Us. Es gibt auch deutschsprachige Podcasts zum Thema „KI“. (Welche besonders gut sind, kann ich noch nicht beurteilen.)

- Und wenn Sie in den sozialen Medien unterwegs sind und Ihre Feeds mit Wissen anreichern möchten, folgen Sie dort diesen und weiteren klugen Köpfen wie Abeba Birhane, Casey Fiesler, Timnit Gebru, Jürgen Geuter, Dan McQuillan, Brian Merchant, Margaret Mitchell, Tom Mullaney und Émile P. Torres. (Natürlich gibt es noch mehr Fachleute in diesem Bereich, aber die genannten sind ein guter Anfang. Da sie oft auch Beiträge von anderen Forschenden teilen, bekommen Sie eine Menge nützliches Wissen auf dem Silbertablett präsentiert.)

[Original: „On the acceptance of GenAI“ – Joep Schuurkes]